Blog sur les contrats numériques

Actualités, tendances et avis d'experts sur les contrats numériques et les signatures électroniques sécurisées.

Nouveautés en matière de contrats numériques : améliorations apportées à OneSpan au premier semestre 2026

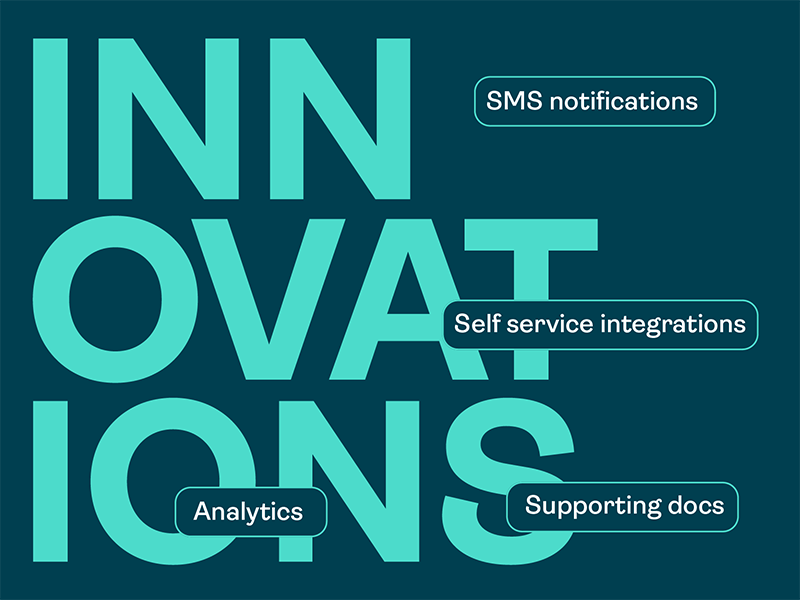

Des nouvelles fonctionnalités d’automatisation des flux de travail à l’amélioration de l’expérience client en passant par une vérification d’identité renforcée, nos dernières innovations en matière de contrats numériques OneSpan Sign sont conçues en pensant à votre organisation.

OneSpan Sign : garantir la confiance numérique dans un monde en mutation

La lettre d'information eSignature d'avril 2026

Les cas d'utilisation

Nouveautés en matière de contrats numériques : améliorations apportées à OneSpan au premier semestre 2026

Aperçus du marché

La lettre d'information eSignature d'avril 2026

Conformité

CANAFE : Préparer votre stratégie de vérification de l'identité pour aller au-delà de la simple conformité

Conformité

Les directives du CANAFE en matière de vérification de l'identité constituent une avance, mais la conformité nécessitera des efforts

Les cas d'utilisation

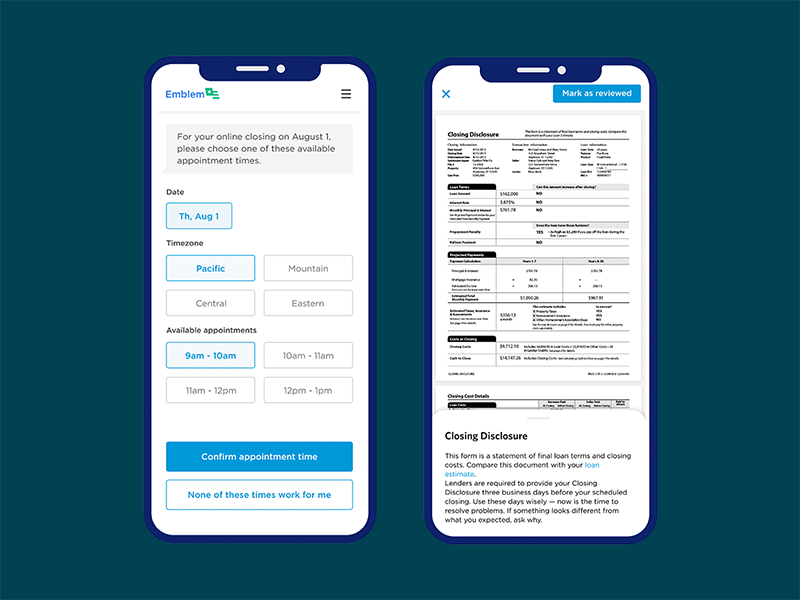

Comment CURE Auto Insurance s'est numérisé avec OneSpan Sign et Guidewire

Développeurs

Développeurs OneSpan Sign : Comment sécuriser les appels API avec OAuth 2.0

Les cas d'utilisation

Innovation: Améliorations OneSpan Sign 2025

Aperçus du marché

Pourquoi les plateformes de prêt repensent-elles les outils de signature électronique en 2026 ?

Aperçus du marché